Show não é só áudio. É tela, loop, transição, imagem que muda a cada música. E alguém precisa produzir tudo isso.

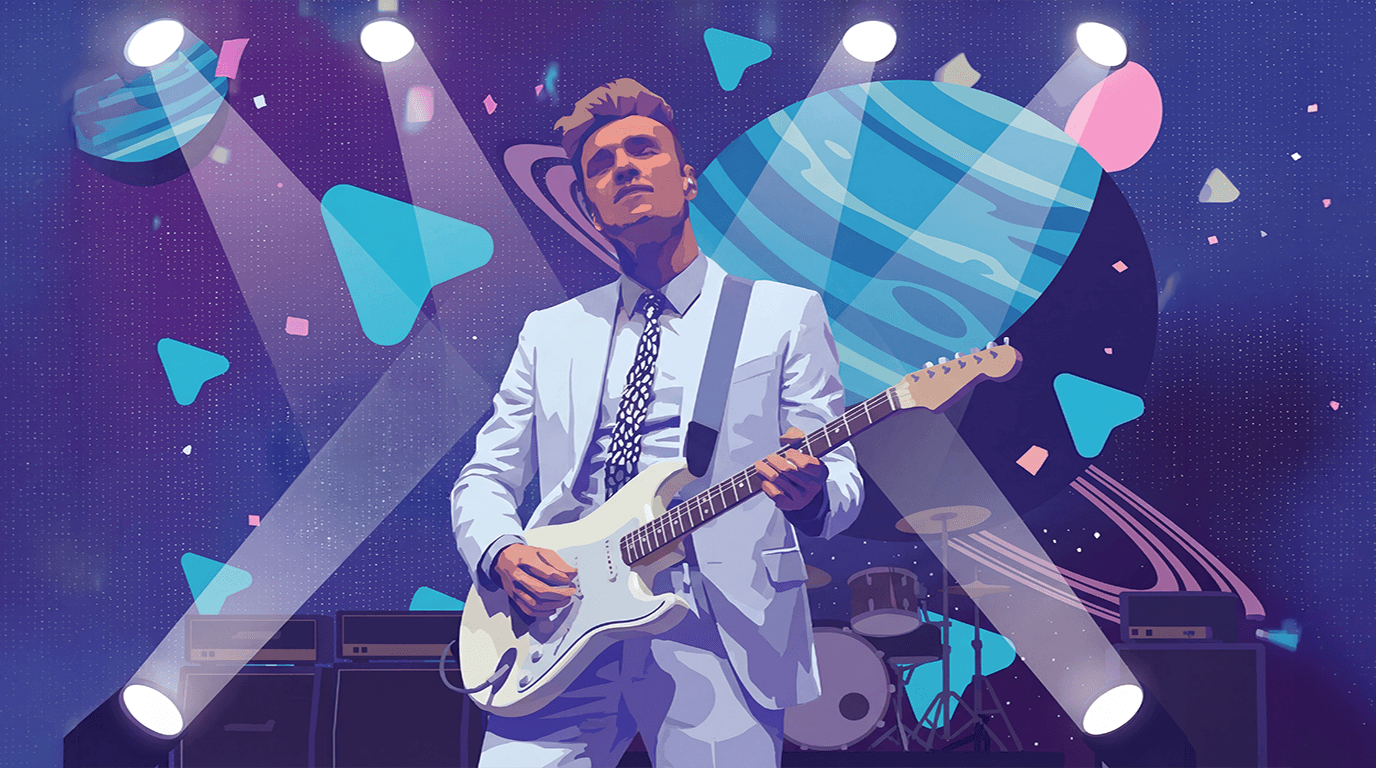

A Aren't Lab cuidou das visuais do show do Nick Carter. O briefing: 150 imagens mais vídeos, em uma semana, com um time aprovando e revisando em tempo real. O tipo de projeto onde normalmente alguma coisa quebra.

Não quebrou nada.

O briefing era uma planilha

Cada música tinha as cenas mapeadas. Uma frase descritiva por momento. No total, 150 imagens pra gerar enquanto os vídeos eram montados em paralelo.

O gargalo clássico desse tipo de projeto é o loop de aprovação. Você gera, espera feedback, ajusta, espera de novo. Com 150 assets, esse loop multiplica por 150.

O workflow que funcionou

Tinham imagens de referência pra cada cena. O primeiro passo foi converter essas referências em texto — extrair o que importava de cada imagem. Depois, de volta pra imagem, mas com o estilo e os elementos que precisavam.

Como muitas cenas compartilhavam estilo ou elementos recorrentes, a iteração foi rápida. Um resultado virava base pro próximo. Remix em cima de remix.

A parte interessante foi usar modelos diferentes dependendo do caso. Nano Banana quando tinha texto na imagem. GPT Image pra cravar estilos específicos. Seedream pra cenas que pediam realismo.

Não tem um modelo que faça tudo bem. Mas quando você consegue escolher o certo pra cada situação, o resultado chega mais rápido.

O que mudou desde então

Esse projeto rodou em meados de 2025. Os modelos disponíveis eram bem mais limitados do que hoje.

As animações foram feitas no Kling 2.0. As imagens, no Nano Banana comum em baixa resolução, com upscaling depois. Funcionou, mas pedia passos extras.

Hoje o mesmo projeto seria mais rápido. O Kling 3 deu um salto absurdo de realismo em cima da v2. Nano Banana Pro, Flux Max e GPT Image 1.5 são modelos mais eficientes, com melhor aderência ao prompt e output direto em 4K — sem upscaling.

A velocidade com que o Dual incorpora modelos novos faz parte do valor. O que seis meses atrás precisava de workaround, hoje sai direto. E o que hoje precisa de workaround, daqui a seis meses provavelmente sai direto também.

O prompt enhancer fez o trabalho pesado

Cada cena tinha uma frase descritiva no briefing. Essas frases eram pensadas pra humano, não pra modelo de IA.

O prompt enhancer transformava em prompts funcionais. "Cena nostálgica dos anos 90 com luzes neon" virava algo que o modelo realmente conseguia interpretar.

Menos tempo escrevendo prompt, mais tempo escolhendo resultado.

A parte colaborativa

Com um time aprovando assets em tempo real, o board compartilhado virou o centro de tudo. Todo mundo via o mesmo canvas. As correções ficavam marcadas ali. Os assets aprovados ficavam separados dos que precisavam de mais uma volta.

Sem isso, o projeto teria virado um pesadelo de arquivos perdidos em pastas, versões soltas e WhatsApp perguntando "qual era a última?".

O resultado

150 imagens. Uma semana. Vídeos sendo montados em paralelo com os assets que iam sendo aprovados.

A pessoa que tocou o projeto resumiu assim: "Demorei mais pra escolher os entregáveis do que pra chegar no resultado certo."

Essa é a virada. Não é que a IA faz o trabalho sozinha. É que o tempo se desloca de produção pra decisão. Menos hora renderizando, mais hora curando.

Aren't Lab usou Dual pra produzir as visuais do show do Nick Carter.